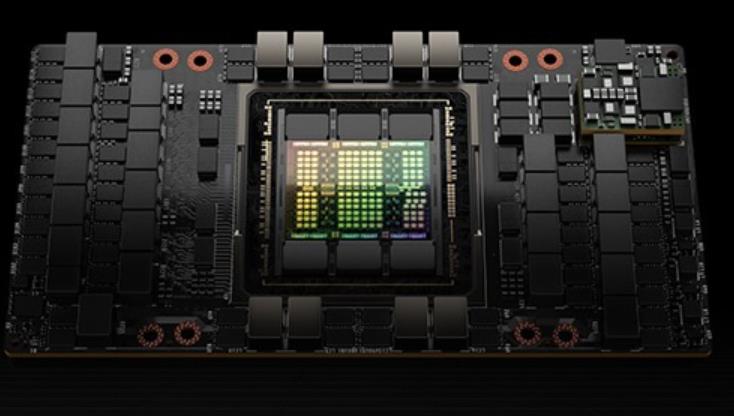

它可能每年产生$500mm++的经常性收入。ChatGPT运行在GPT-4和API上。GPT-4和API需要GPU才能运行。很多。OpenAI希望为ChatGPT及其API发布更多功能,但他们不能,因为他们无法访问足够的GPU。他们通过Microsoft/Azure购买了很多NvidiaGPU。具体来说,他们想要的GPU是NvidiaH100GPU。为了制造H100SXMGPU,Nvidia使用台积电进行制造,并使用台积电的CoWoS封装技术,并使用主要来自SK海力士的HBM3。OpenAI并不是***一家想要GPU的公司(但他们是产品市场契合度强的公司)。其他公司也希望训练大型AI模型。其中一些用例是有意义的,但有些用例更多的是驱动的,不太可能使产品与市场契合。这推高了需求。此外,一些公司担心将来无法访问GPU,因此即使他们还不需要它们,他们现在也会下订单。因此,“对供应短缺的预期会造成更多的供应短缺”正在发生。GPU需求的另一个主要贡献者来自想要创建新的LLM的公司。以下是关于想要构建新LLM的公司对GPU需求的故事:公司高管或创始人知道人工智能领域有很大的机会。也许他们是一家想要在自己的数据上训练LLM并在外部使用它或出售访问权限的企业,或者他们是一家想要构建LLM并出售访问权限的初创公司。他们知道他们需要GPU来训练大型模型。H100 GPU 的功耗设计为 400W。NVLINKH100GPU how much

在人工智能应用中,H100 GPU 的计算能力尤为突出。它能够快速处理大量复杂的模型训练和推理任务,大幅缩短开发时间。H100 GPU 的并行计算能力和高带宽内存使其能够处理更大规模的数据集和更复杂的模型结构,提升了AI模型的训练效率和准确性。此外,H100 GPU 的高能效比和稳定性也为企业和研究机构节省了运营成本,是人工智能开发的理想选择。对于科学计算而言,H100 GPU 提供了强大的计算能力。它能够高效处候模拟、基因组学研究、天体物理学计算等复杂的科学任务。H100 GPU 的大规模并行处理单元和高带宽内存可以提升计算效率和精度,使科学家能够更快地获得研究成果。其稳定性和可靠性也为长时间计算任务提供了坚实保障,是科学计算领域不可或缺的工具。AmericaH100GPU优惠能够实现更加复杂和逼真的游戏画面。

H100 GPU 通过其强大的计算能力和高效的数据传输能力,为分布式计算提供了强有力的支持。其并行处理能力和大带宽内存可以高效处理和传输大量数据,提升整体计算效率。H100 GPU 的稳定性和可靠性为长时间高负荷运行的分布式计算任务提供了坚实保障。此外,H100 GPU 的灵活扩展能力使其能够轻松集成到各种分布式计算架构中,满足不同应用需求,成为分布式计算领域的重要工具。H100 GPU 的市场价格在过去一段时间内经历了明显的波动。随着高性能计算需求的增加,H100 GPU 在人工智能、深度学习和大数据分析等领域的应用越来越多,市场需求不断攀升,推动了价格的上涨。同时,全球芯片短缺和物流成本的上升也对 H100 GPU 的价格产生了不利影响。尽管如此,随着供应链的逐步恢复和市场需求的平衡,H100 GPU 的价格有望在未来逐渐回落。对于企业和研究机构来说,了解价格动态并选择合适的采购时机至关重要。

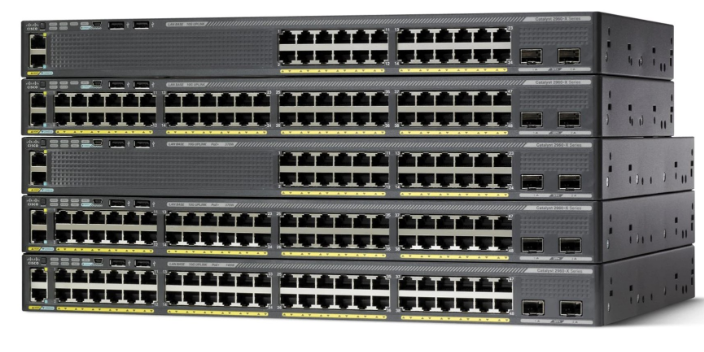

大多数GPU用于什么用途?#对于使用私有云(CoreWeave、Lambda)的公司,或拥有数百或数千台H100的公司,几乎都是LLM和一些扩散模型工作。其中一些是对现有模型的微调,但大多数是您可能还不知道的从头开始构建新模型的新创业公司。他们正在签订为期3年、价值1000万至5000万美元的合同,使用几百到几千台GPU。对于使用带有少量GPU的按需H100的公司来说,其LLM相关使用率可能仍>50%。私有云现在开始受到企业的青睐,这些企业通常会选择默认的大型云提供商,但现在大家都退出了。大型人工智能实验室在推理还是训练方面受到更多限制?#取决于他们有多少产品吸引力!SamAltman表示,如果必须选择,OpenAI宁愿拥有更多的推理能力,但OpenAI在这两方面仍然受到限制。H100 GPU 提供高效的 GPU 直连技术。

ITMALL.sale 始终坚持以客户为中心的服务理念,不断提升自身的服务水平和产品质量。通过建立严格的质量控制体系,ITMALL.sale 确保每一台 H100 GPU 产品都经过严格检测,确保性能稳定和可靠。ITMALL.sale 还与多家企业建立了长期合作关系,凭借良好的信誉和质量的服务赢得了客户的信赖。ITMALL.sale 的目标是成为 H100 GPU 市场的,为客户提供质量的产品和服务,助力客户业务的快速发展。ITMALL.sale 以其质量的服务和产品在市场上赢得了良好的口碑。作为 H100 GPU 的专业代理商,ITMALL.sale 不仅能够提供具有竞争力的价格,还能够确保产品的质量和可靠性。通过与 NVIDIA 的紧密合作,ITMALL.sale 能够及时获取的产品信息和技术更新,为客户提供的 H100 GPU 产品和技术解决方案。无论是企业级客户还是个人用户,都能够在 ITMALL.sale 找到满足其需求的 H100 GPU 产品和服务。H100 GPU 的基础时钟频率为 1410 MHz。上海H100GPU折扣

H100 GPU 特价出售,数量有限。NVLINKH100GPU how much

稀疏性特征利用了深度学习网络中的细粒度结构化稀疏性,使标准张量性能翻倍。新的DPX指令加速了动态规划算法达到7倍。IEEEFP64和FP32的芯片到芯片处理速率提高了3倍(因为单个SM逐时钟(clock-for-clock)性能提高了2倍;额外的SM数量;更快的时钟)新的线程块集群特性(ThreadBlockClusterfeature)允许在更大的粒度上对局部性进行编程控制(相比于单个SM上的单线程块)。这扩展了CUDA编程模型,在编程层次结构中增加了另一个层次,包括线程(Thread)、线程块(ThreadBlocks)、线程块集群(ThreadBlockCluster)和网格(Grids)。集群允许多个线程块在多个SM上并发运行,以同步和协作的获取数据和交换数据。新的异步执行特征包括一个新的张量存储加速(TensorMemoryAccelerator,TMA)单元,它可以在全局内存和共享内存之间非常有效的传输大块数据。TMA还支持集群中线程块之间的异步拷贝。还有一种新的异步事务屏障,用于进行原子数据的移动和同步。新的Transformer引擎采用专门设计的软件和自定义Hopper张量技术相结合的方式。Transformer引擎在FP8和16位计算之间进行智能管理和动态选择,在每一层中自动处理FP8和16位之间的重新选择和缩放。NVLINKH100GPU how much

文章来源地址: http://smdn.m.chanpin818.com/zjfwq/fwqgzz/deta_25360895.html

免责声明: 本页面所展现的信息及其他相关推荐信息,均来源于其对应的用户,本网对此不承担任何保证责任。如涉及作品内容、 版权和其他问题,请及时与本网联系,我们将核实后进行删除,本网站对此声明具有最终解释权。

[VIP第1年] 指数:3

[VIP第1年] 指数:3